회귀분석

: 한 변수와 다른 변수간의 관계를 모델링

: 하나 이상의 독립변수(원인변수)들이 종속변수(결과변수)에 미치는 영향을 예측

: 종속변수가 범주형이면 로지스틱 회귀분석을 사용한다

: 변수들이 일정한 경향성을 띤다는 것은 그 변수들이 일정한 인과관계를 갖고 있다고 추측할 수 있다.

: 산점도를 봤을 때 일정한 추세선이 나타난다면 경향성을 가지거나 변수들 간에 인과관계가 존재한다고 생각할 수 있다.

회귀분석의 종류

회귀분석의 가정 4가지

① 선형성

: 입력변수와 출력변수의 관계가 선형

: 다항회귀분석의 경우 선형성을 갖지 않아도 된다.

② 독립성

: 잔차와 독립변수의 값이 서로 독립적

: 다중회귀분석의 경우 독립변수들 간에 상관성이 없이 독립이어야 한다.

: 상관성이 존재하는 경우 다중공선성이라고 하며, 이를 제거하고 회귀분석을 수행해야 한다.

: Durbin-Waston 통계량을 사용

③ 등분산성

: 모든 독립 변수 값에 대한 오차 항의 분산이 일정하다는 가정

: 잔차플롯(산점도)을 활용하여 잔차와 입력변수간에 아무런 관련성이 없게 무작위적으로 고루 분포되어야 만족

A: 설명변수(x) 가 커질 수록 잔차의 분산이 줄어드는 이분산의 형태

B: 2차항 설명변수 필요

C: 새로운 설명변수 필요

④정규성

: Q-Q Plot 을 출력했을 때, 잔차가 대각방향의 직선의 형태를 지니고 있다

⑤ 비상관성

: 관측치들의 잔차들끼리 상관이 없어야 한다.

단순선형회귀분석

: 하나의 독립 변수와 하나의 종속 변수 간의 선형 관계를 분석

회귀분석에서의 검토사항

① 모형이 통계적으로 유의미한가?

: F통계량을 확인한다. 유의수준 5% 하에서 F통계량의 p-값이 0.05보다 작으면 유의미

② 회귀계수들이 유의미한가?

: 해당 계수의 t-통계량의 p-값 또는 이들의 신뢰구간을 확인

③ 모형이 얼마나 설명력을 갖는가?

: 결정계수(R^2)를 확인한다. 결정계수는 0에서 1값을 가지며, 1일 수록 설명력이 높음

④ 모형이 데이터를 잘 적합하고 있는가?

: 잔차를 그래프로 그리고 회귀진단을 한다.

최소제곱법으로 회귀계수의 추정

: 단순선형회귀나 다중선형회귀에서 모델 파라미터를 추정하는 데에 적용

: 적합도를 최대화하는 회귀 계수를 찾을 수 있다.

* 적합도: 모델이 실제 데이터와 얼마나 잘 맞는지

: 측정값을 기초로 하여 적당한 제곱합을 만들고, 그것을 최소로 하는 값을 구하여 측정결과를 처리하는 방법

: 잔차제곱이 가장 작은 선을 구하는 것을 의미

결정계수

SSR(회귀제곱합): 우리 모형이 설명하고 있는것

SSE(오차제곱합): 우리 모형이 설명하지 못하고 있는 것

SST(전체제곱합): 전체길이

다중선형회귀분석

: 2개 이상의 독립변수에 대하여 종속변수의 관계를 수치적으로 파악하기 위한 기법

다중공선성

: 다중선형회귀분석에서 사용된 독립 변수들 간에 강한 상관관계가 나타나는 현상

: 독립 변수들 간의 높은 상관관계로 인해 회귀 모델의 안정성이나 해석이 어려워지는 문제를 일으킬 수 있다.

다중공선성 진단

: 독립변수의 p-value 값이 커서 개별 인자가 유의하지 않은 경우 다중공선성을 의심할 수 있다.

: 공분산 행렬을 확인한다

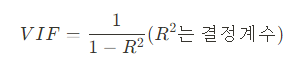

: 분산팽창요인(VIF) 을 구해 이 값이 10을 넘는다면 다중공선성이 있다고 판단, 30보다 크면 심각하다고 해석

* VIF: 다중공선성을 수치로 표현

다중공선성 문제 해결법

: 필요한 경우 변수를 삭제하거나 변환

: 주성분분석(PCA)을 통해 변수의 차원을 축소

: 스크리 산점도(Scree plot) 를 사용해 주성분 개수 선택

: 선형판별분석(LDA) 으로 차원 축소

: t-분포 확률적 임베딩(t-SNE) 으로 차원 축소

최적 회귀방식과 고급 회귀분석

: 여러개의 독립변수 중 종속변수를 설명하기 가장 좋은 독립변수를 선택하고 최적의 회귀방정식을 찾는 것

: 모델 성능을 향상시키기 위해 사용

단계적 변수선택법

: 일정한 단계를 거치면서 변수를 추가하거나 제거하는 방식으로 최적화

① 전진선택법

: 절편만 있는 상수모형부터 시작하여 설명변수부터 차례로 모형에 추가

② 후진제거법

: 독립변수 후보 모두를 포함한 모형에서 출발해 가장 적은 영향을 주는 변수부터 제거

③ 단계선택법

: 전진선택법으로 추가, 후진제거법으로 제거

변수선택에 사용되는 성능지표

: AIC, BIC 가 최소가 되는 모형을 선택해야 한다.

: 벌점화 방식 - 모형의 복잡도에 벌점을 주는 방법

: AIC - 모델의 상대적인 품질 측정

: BIC - AIC 단점을 보완

정규화 선형회귀

: 모델이 과도하게 최적화되는 현상(과적합)을 막는 방법

: 잘 설명하고 싶어서 모형을 과하게 넣는 것

과적합과 과소적합

: 과적합되면 일반화 성능이 낮아져 이미 학습한 훈련용 데이터에 대한 성능은 높게 나오지만, 학습하지 않은 데이터의 성능은 낮게 나온다.

: 과소적합은 학습 데이터조차 제대로 예측 못함

정규화 선형회귀의 종류

: 계수의 크기를 제한 하는 방법

① 라쏘

: L1 규제

: 가중치들의 절댓값의 합을 최소화하는 것을 제약조건으로 추가

② 릿지

: L2 규제

: 가중치들의 제곱합을 최소화하는 것을 제약조건으로 추가

③ 엘라스틱넷

: 라쏘와 릿지를 결합

일반화 선형회귀

: 종속변수가 정규분포를 따른 다는 것을 전제

: 종속변수가 범주형 자료이거나 정규성을 만족하지 못하는 경우 수행

로지스틱 회귀

: 범주형이면 로지스틱

: 독립변수에 의해 종속변수의 범주로 분류화

포아송 회귀

: 종속변수가 특정 시간 동안 발생한 사건의 건수에 대한 도수 자료인 경우

더빈왓슨검정(Durbin-Watson)

: 오차항이 독립성을 만족하는지 검정

회귀분석

: 독립변수와 종속변수는 모두 연속형 변수일 때 사용 가능

: 종속변수가 범주형 변수인 경우 로지스틱 회귀분석 사용

데이터의 정규성을 확인하는 방법

: Q-Q plot, 히스토그램, Shaprio-Wilk

'ADsP 내용 정리' 카테고리의 다른 글

| 통계분석 - 시계열분석 (0) | 2024.04.09 |

|---|---|

| 통계분석 - 다변량 분석 (0) | 2024.04.09 |

| 통계분석 - 기초통계 (0) | 2024.04.08 |

| 통계분석 - 통계개요 (1) | 2024.04.01 |

| 데이터 전처리 (0) | 2024.04.01 |